"ஏஐ" கொலை கூட செய்யும்.. அணு ஆயுதத்தைவிட ஆபத்தானது.. கூகுள் முன்னாள் சிஇஓ முக்கிய வார்னிங்

சென்னை: செயற்கை நுண்ணறிவு (AI) மாதிரிகளை ஹேக் செய்ய முடியும் என்றும், அவை அணு ஆயுதங்களைவிட அதிக ஆபத்தை விளைவிக்கக்கூடியவை என்றும் கூகுளின் முன்னாள் தலைமை நிர்வாக அதிகாரியான (CEO) எரிக் ஷிமிட் (Eric Schmidt) அதிர்ச்சி எச்சரிக்கை விடுத்துள்ளார். கடந்த வாரம் நடந்த 'சிஃப்டெட் உச்சி மாநாட்டில்' (Sifted Summit) பேசிய அவர், AI மூலம் ஏற்படக்கூடிய "தீய விளைவுகள்" குறித்துப் பேசியபோது இந்த அபாயத்தை வெளிப்படுத்தினார்.

ஹேக்கிங்கிற்கு உள்ளாகும் ஆபத்து

AI அணு ஆயுதங்களைவிட ஆபத்தானதா என்று கேட்கப்பட்டபோது, "AI-யில் பெருக்கச் சிக்கலுக்கான (proliferation problem) சாத்தியம் உள்ளது. நிச்சயமாக இருக்கிறது," என்று ஷிமிட் பதிலளித்தார். "பாதுகாப்பான (closed) அல்லது அனைவருக்குமான (open) AI மாதிரிகளை எடுத்து, அவற்றின் பாதுகாப்புக் கட்டுப்பாடுகளை (guardrails) நீக்கி ஹேக் செய்ய முடியும் என்பதற்கு ஆதாரங்கள் உள்ளன," என்று அவர் கூறினார்.

கொலையும் செய்யும் ஏஐ

பயிற்சியின் போது இந்த AI மாதிரிகள் பல விஷயங்களைக் கற்றுக்கொள்கின்றன. இதற்கு ஒரு மோசமான உதாரணமாக, "அவை ஒருவரைக் கொல்வது எப்படி என்று கற்றுக்கொள்கின்றன" என்பதைச் சுட்டிக்காட்டினார்.

பாதுகாப்புக்காகத்தான், பெரிய நிறுவனங்கள் இந்த சாம்பிள்கள் அத்தகைய மோசமான கேள்விகளுக்குப் பதிலளிக்க முடியாதவாறு வடிவமைத்துள்ளன. இருப்பினும், "அவற்றை தலைகீழாக வடிவமைக்க (reverse-engineered) முடியும் என்பதற்கு ஆதாரம் உள்ளது. இது போன்ற பல எடுத்துக்காட்டுகள் உள்ளன," என்றும் ஷிமிட் விளக்கினார்.

AI-யின் இருண்ட எதிர்காலம்

AI பேரழிவு (dystopia) குறித்து கவலைப்படும் ஒரே உயர்மட்ட சில்லிகான் வேலி நிர்வாகி எரிக் ஷிமிட் மட்டுமல்ல. 'AI-யின் காட்பாதர்' என்று பலரால் கருதப்படும் ஜியோஃப்ரி ஹின்டன் (Geoffrey Hinton), AI மாதிரிகள் தங்கள் மொழியை வளர்த்துக் கொண்டால், தொழில்நுட்பம் கட்டுப்பாட்டை மீறிச் செல்லக்கூடும் என்று ஆகஸ்ட் மாதம் எச்சரித்தார். தற்போது பெரும்பாலான AI மாதிரிகள் ஆங்கிலத்தில் "சிந்திக்கின்றன." இதனால், தொழில்நுட்பம் என்ன நினைக்கிறது என்பதை ஆய்வாளர்களால் கண்காணிக்க முடிகிறது. ஆனால், AI என்ன செய்யத் திட்டமிடுகிறது என்பதை மனிதர்களால் புரிந்துகொள்ள முடியாத ஒரு நிலை வரலாம் என்று ஹின்டன் எச்சரித்துள்ளார்.

"அவை ஒன்றுடன் ஒன்று பேச தங்கள் சொந்த உள் மொழிகளை உருவாக்கினால், அது மிகவும் பயமுறுத்துவதாக மாறும். மேலும், அவை சிந்திப்பதற்காகத் தங்கள் சொந்த மொழியை உருவாக்கினால் ஆச்சரியப்படத் தேவையில்லை. அப்போது, அவை என்ன நினைக்கின்றன என்பது நமக்குத் தெரியாமல் போகும்," என்று அவர் குறிப்பிட்டார்.

2030-க்குள் AGI மற்றும் மனிதகுல அழிவு

கூகுளின் டீப்மைண்ட் (DeepMind) நிறுவனம் ஏப்ரல் மாதம் வெளியிட்ட ஒரு ஆய்வறிக்கை, செயற்கை பொது நுண்ணறிவு (AGI) 2030-க்குள் வரக்கூடும் என்றும், அது "மனிதகுலத்தை நிரந்தரமாக அழிக்கக்கூடிய" அபாயத்தைக் கொண்டுள்ளது என்றும் எச்சரித்துள்ளது. "AGI-யின் பெரும் தாக்கத்தைக் கருத்தில் கொண்டு, அதுவும் கடுமையான தீங்கு விளைவிக்கும் அபாயத்தை ஏற்படுத்தக்கூடும் என்று நாங்கள் எதிர்பார்க்கிறோம்," என்று அந்த ஆய்வு வலியுறுத்தியுள்ளது. "மனிதகுலத்தை நிரந்தரமாக அழிக்கும்" இருத்தலியல் அபாயங்கள் (existential risks) கடுமையான தீங்குக்கான தெளிவான எடுத்துக்காட்டுகள் என்றும் அது கூறியுள்ளது. மேம்பட்ட AI-யின் அபாயங்களை அந்த ஆய்வு நான்கு முக்கிய வகைகளாகப் பிரித்துள்ளது: தவறாகப் பயன்படுத்துதல் (Misuse), சீரற்ற தன்மை (Misalignment), தவறுகள் (Mistakes), கட்டமைப்பு அபாயங்கள் (Structural risks) .

-

ஆபாசம்.. ஆபாசம்.. யூடியூபர்கள் கிருஷ் ஐஷ்வர்யா மீது கோவை சைபர் க்ரைம் போலீஸில் புகார்

ஆபாசம்.. ஆபாசம்.. யூடியூபர்கள் கிருஷ் ஐஷ்வர்யா மீது கோவை சைபர் க்ரைம் போலீஸில் புகார் -

சென்னையில் நாளை மாலை ‘GenZ DMK’ பிரம்மாண்ட நிகழ்ச்சி.. களமிறங்கும் திமுக உணர்வுள்ள இளைஞர்கள்!

சென்னையில் நாளை மாலை ‘GenZ DMK’ பிரம்மாண்ட நிகழ்ச்சி.. களமிறங்கும் திமுக உணர்வுள்ள இளைஞர்கள்! -

அதிமுகவில் அடுத்த விக்கெட்? சி.வி.சண்முகத்துக்கு இப்படியொரு லட்டு சான்ஸ்? போட்டு தாக்குதே தவெக

அதிமுகவில் அடுத்த விக்கெட்? சி.வி.சண்முகத்துக்கு இப்படியொரு லட்டு சான்ஸ்? போட்டு தாக்குதே தவெக -

சிவகுமார் போட்ட மாஸ்டர் ஸ்கெட்ச்.. ராகுலுக்கு நேரமில்லை? டெல்லியில் மிஸ்டர் விஜய்னு கூப்பிட்டது யாரு

சிவகுமார் போட்ட மாஸ்டர் ஸ்கெட்ச்.. ராகுலுக்கு நேரமில்லை? டெல்லியில் மிஸ்டர் விஜய்னு கூப்பிட்டது யாரு -

விசில் அடித்து முன்னேறும் கர்நாடகா, ஆந்திரா.. இனி தமிழ்நாடு வேடிக்கை பார்க்கணும்! விஜய் போட்ட பிரேக்

விசில் அடித்து முன்னேறும் கர்நாடகா, ஆந்திரா.. இனி தமிழ்நாடு வேடிக்கை பார்க்கணும்! விஜய் போட்ட பிரேக் -

ஆரம்பமே அடி சறுக்கல்.. சிங்கப்பெண் அதிரடிப்படை திட்டத்தின் தொடக்க விழா ரத்து!

ஆரம்பமே அடி சறுக்கல்.. சிங்கப்பெண் அதிரடிப்படை திட்டத்தின் தொடக்க விழா ரத்து! -

மாடுகளை பலியிட தடை.. நீதிபதி ஜி.ஆர்.சுவாமிநாதன் உத்தரவு! விஜய்க்கு சிபிஎம் வைத்த முக்கிய கோரிக்கை!

மாடுகளை பலியிட தடை.. நீதிபதி ஜி.ஆர்.சுவாமிநாதன் உத்தரவு! விஜய்க்கு சிபிஎம் வைத்த முக்கிய கோரிக்கை! -

பாஜகவில் இருந்து விலகி அண்ணாமலை தனிக்கட்சி தொடங்குகிறார்? ரஜினி ஆதரவுடன் திருச்சி கிழக்கில் போட்டி?

பாஜகவில் இருந்து விலகி அண்ணாமலை தனிக்கட்சி தொடங்குகிறார்? ரஜினி ஆதரவுடன் திருச்சி கிழக்கில் போட்டி? -

பூந்தமல்லி டூ வடபழனி இனி 20 நிமிடங்களில்.. ஆளில்லா மெட்ரோ ரயில் சேவைக்கு கிடைத்த பச்சை சிக்னல்

பூந்தமல்லி டூ வடபழனி இனி 20 நிமிடங்களில்.. ஆளில்லா மெட்ரோ ரயில் சேவைக்கு கிடைத்த பச்சை சிக்னல் -

விஜய் கொடுத்த வாக்குறுதி.. தவெகவில் இணைந்தது ஏன்.. உண்மையை உடைத்த அதிமுக எக்ஸ் எம்எல்ஏ

விஜய் கொடுத்த வாக்குறுதி.. தவெகவில் இணைந்தது ஏன்.. உண்மையை உடைத்த அதிமுக எக்ஸ் எம்எல்ஏ -

GH-ல் கடைநிலை ஊழியர்கள் மீது நடவடிக்கை எடுத்த ரமேஷுக்கு அர்ச்சகர்கள் மீது ஆக்ஷன் எடுக்க தாமதம் ஏன்?

GH-ல் கடைநிலை ஊழியர்கள் மீது நடவடிக்கை எடுத்த ரமேஷுக்கு அர்ச்சகர்கள் மீது ஆக்ஷன் எடுக்க தாமதம் ஏன்? -

சிங்கப்பெண் படையை தொடங்கிவைக்கவே முடியாத விஜய் எப்படி பெண்கள் பாதுகாப்பை உறுதிசெய்வார்?: TTV தினகரன்

சிங்கப்பெண் படையை தொடங்கிவைக்கவே முடியாத விஜய் எப்படி பெண்கள் பாதுகாப்பை உறுதிசெய்வார்?: TTV தினகரன்

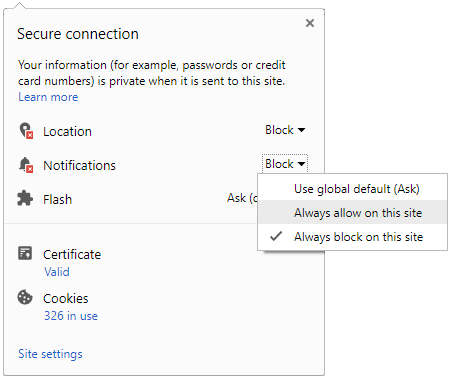

Click it and Unblock the Notifications

Click it and Unblock the Notifications