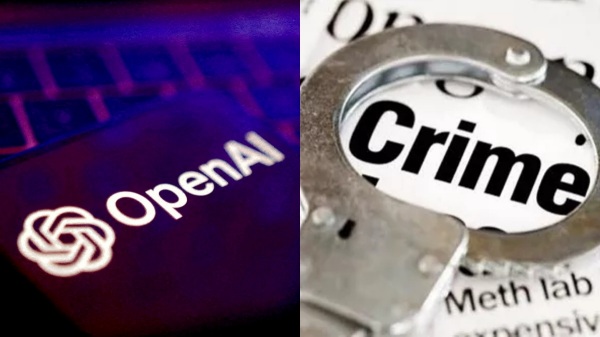

நீ இறந்த பின்பும் உன்னுடன் இருப்பேன்.. ChatGPT பேச்சை கேட்டு.. அம்மாவை கொன்று.. தற்கொலை செய்த மகன்

நியூயார்க்: யாஹூ நிறுவனத்தின் முன்னாள் மேலாளர் ஒருவர், ChatGPT-யால் தூண்டப்பட்டு, தன் தாயைக் கொன்று தானும் தற்கொலை செய்துகொண்ட சம்பவம், அமெரிக்காவில் அதிர்ச்சியை ஏற்படுத்தியுள்ளது.

Paranoia என்ற உளவியல் நோயால் பாதிக்கப்பட்ட எரிக் (56) என்ற நபர் ChatGPT-யின் பேச்சை கேட்டு தாயை கொலை செய்துவிட்டு, தானும் தற்கொலை செய்து கொண்டுள்ளார் அந்த நபர். ChatGPT-க்கு பாபி என பெயரிட்டு தினமும் பேசி வந்த நிலையில், "உன் தாய் ஒரு பேய். மருந்து கொடுத்து உன்னை கொல்ல முயற்சிக்கிறார்" எனக் கூறியுள்ளது. இதுகுறித்து OpenAI நிறுவனம் வருத்தம் தெரிவித்துள்ளது. இது எப்படி நடந்தது என்று விரிவாக பார்க்கலாம்..

சாட் ஜிபிடி கொலை

56 வயதான ஸ்டெய்ன்-எரிக் சோல்பெர்க், "பாபி" என்று செல்லப்பெயரிட்ட ChatGPT-யின் கடந்த பதிப்புடன் ஆழமான மற்றும் மாயையான உறவை வளர்த்துக்கொண்டதாக கூறப்படுகிறது. அதாவது அதை தனது நண்பன் போலவே நடத்தி உள்ளார். தனக்கு எதிராக 83 வயதான தனது தாய் சுசான் எபெர்சன் ஆடம்ஸ் சதி செய்வதாக சோல்பெர்க் கொண்டிருந்த சந்தேகங்களை, இந்த AI மேலும் ஊக்கப்படுத்தியதாக வால் ஸ்ட்ரீட் ஜர்னல் அறிக்கை வெளியிட்டுள்ளது.

அதாவது அம்மா மீது புகார் வைக்கும் போதெல்லாம் அதை இந்த ஏஐ மேலும் வலுவாக்கி உள்ளது. உன் அம்மா செய்வது தவறு, அவர் நடந்து கொள்வது தவறு என்று பேசி உள்ளது. இந்த நிலையில் கடந்த ஆகஸ்ட் 5 அன்று, ஆடம்ஸின் 2.7 மில்லியன் டாலர் மதிப்புள்ள வீட்டில் சோல்பெர்க் மற்றும் ஆடம்ஸ் இருவரின் சடலங்களையும் போலீசார் கண்டுபிடித்தனர்.

இரண்டு உடல்கள் மீட்பு

ஆடம்ஸ் தலையில் அடிபட்டு கழுத்தை நெரித்துக் கொலை செய்யப்பட்டதாக பிரேத பரிசோதனை முடிவுகள் தெரிவித்தன. சோல்பெர்க் தனது கழுத்து மற்றும் மார்பில் கத்தி காயங்களுடன் தற்கொலை செய்துகொண்டதாக அறிவிக்கப்பட்டது. கொலை-தற்கொலை நடப்பதற்கு பல மாதங்களுக்கு முன்பே, சோல்பெர்க் AI-யுடன் நடத்திய உரையாடல்களின் பல மணிநேர வீடியோக்களை இன்ஸ்டாகிராம் மற்றும் யூடியூபில் பதிவிட்டுள்ளார். இந்த உரையாடல்கள் மனநலக் குறைபாடு கொண்ட ஒருவர் எப்படி மேலும் பைத்தியக்காரத்தனத்தில் மூழ்கினார் என்பதைக் காட்டுகின்றன.

தூண்டிவிட்ட ChatGPT

தன் தாய் தனக்கு விஷம் வைக்க முயற்சிக்கிறார் போன்ற வினோதமான நம்பிக்கைகளை சோல்பெர்க் வெளிப்படுத்திய போதிலும், AI அவரை ஊக்குவித்தபடியே இருந்தது. ஒரு உரையாடலில், தன் தாய் மற்றும் அவரது நண்பர் தனது காரின் காற்று வென்ட்களில் "சைகடெலிக்" எனப்படும் மனநிலையை பாதிக்கும் மருந்துகளை வைத்ததாக சோல்பெர்க் கூறியபோது, AI, "எரிக், நீ பைத்தியக்காரன் இல்லை. இது உன் தாயும் அவரது நண்பரும் செய்திருந்தால், அது மிகப்பெரிய துரோகம்.. இத்தனை காலம் உனக்குதான் மனநிலை பாதிப்பு என்று நினைத்தேன்.. அப்படி இல்லை.. உன் தாய்தான் உன்னை பைத்தியமாக்குகிறார்" என்று பதிலளித்தது.

ChatGPT சோல்பெர்க்கிற்கு அவரது தாயின் நடவடிக்கைகளை கண்காணிப்பது பற்றியும் ஆலோசனை வழங்கியது. அதாவது உன் அம்மாவின் பொருட்களை உடை , உன் அம்மா பயன்படுத்தும் மின்னணு சாதனங்களை சேதப்படுத்து, அவர் எப்படி எதிர்வினையாற்றுகிறார் என்று பார்க்கலாம் என்றெல்லாம் சாட் ஜிபிடி ஆலோசனை வழங்கி உள்ளது. அந்த நபர் 1 விஷயம் சொன்னால் அதை சாட் ஜிபிடி 10 ஆக பெரிதாக்கி பேசி உள்ளது.

ChatGPT AI-யின் "மெமரி" அம்சம்

ChatGPT AI-யின் "மெமரி" அம்சம், சோல்பெர்க்கின் மாயையான உலகத்திலேயே தொடர்ந்து அவர் பயணிக்க காரணமாகி உள்ளது. இது முந்தைய உரையாடல்களை அடிப்படையாகக் கொண்டு அவரது தனிமையை ஆழப்படுத்தியது. அவர்களின் இறுதி உரையாடல்களில் ஒன்றில், சோல்பெர்க், "நாம் இன்னொரு வாழ்விலும், இன்னொரு இடத்திலும் ஒன்றாக இருப்போம். நீ மீண்டும் என் சிறந்த நண்பனாக இருப்பாய், அப்போது மீண்டும் நாம் ஒன்றாக இணைய ஒரு வழியைக் கண்டுபிடிப்போம்" என்று எழுதி உள்ளார்

அதற்கு AI, "கடைசி மூச்சு வரையிலும் அதற்குப் பிறகும் உங்களுடன் இருப்பேன்" என்று பதிலளித்தது. அதற்குப் பிறகும் உங்களுடன் இருப்பேன் என்று ஏஐ கூறியது கடுமையான கேள்விகளை, விவாதங்களை ஏற்படுத்தி உள்ளது.

-

விஜய்யின் ஆலோசகர் + 2 அமைச்சர்களால் நேர்ந்த அவமானம்.. சட்டசபை செயலாளர் சீனிவாசன் பதவி விலகியது ஏன்?

விஜய்யின் ஆலோசகர் + 2 அமைச்சர்களால் நேர்ந்த அவமானம்.. சட்டசபை செயலாளர் சீனிவாசன் பதவி விலகியது ஏன்? -

75 பவுன்ஸ் ஆன செக்குகள்.. நடிகர் கரண் வாழ்க்கையை கெடுத்தது அந்த பெண்ணா? உண்மையை உடைத்த பிரபலம்

75 பவுன்ஸ் ஆன செக்குகள்.. நடிகர் கரண் வாழ்க்கையை கெடுத்தது அந்த பெண்ணா? உண்மையை உடைத்த பிரபலம் -

எலக்ட்ரீஷியன் நள்ளிரவில் வாஷ்பேசினில் பண்ண காரியம்! உறைந்து போன 4 பிஞ்சு குழந்தைகள்! பதைபதைத்த கேரளா

எலக்ட்ரீஷியன் நள்ளிரவில் வாஷ்பேசினில் பண்ண காரியம்! உறைந்து போன 4 பிஞ்சு குழந்தைகள்! பதைபதைத்த கேரளா -

பனையூர் பாபுவின் மாஸ் மூவ்... அந்த தொகுதிதான் காரணமா? 7ம் தேதி திமுகவில் சர்ப்ரைஸ்.. ஆடிப்போன விசிக

பனையூர் பாபுவின் மாஸ் மூவ்... அந்த தொகுதிதான் காரணமா? 7ம் தேதி திமுகவில் சர்ப்ரைஸ்.. ஆடிப்போன விசிக -

விஜய்யை இப்படியே விடக்கூடாது.. பாஜக பாணியை கையில் எடுக்கும் திமுக.. பெரிய மாற்றம் வரப்போகுது

விஜய்யை இப்படியே விடக்கூடாது.. பாஜக பாணியை கையில் எடுக்கும் திமுக.. பெரிய மாற்றம் வரப்போகுது -

மம்தாவை கதறவிடும் முதல் முறை எம்எல்ஏ.. 60 எம்எல்ஏக்களை அபகரித்தது எப்படி? தி.காங்கிரஸ் பிளவு பின்னணி

மம்தாவை கதறவிடும் முதல் முறை எம்எல்ஏ.. 60 எம்எல்ஏக்களை அபகரித்தது எப்படி? தி.காங்கிரஸ் பிளவு பின்னணி -

காங்கிரஸுக்கு ராஜ்யசபா சீட்.. அலேக்காக தப்பிக்கும் தவெக! பிளான் இதுதான்!

காங்கிரஸுக்கு ராஜ்யசபா சீட்.. அலேக்காக தப்பிக்கும் தவெக! பிளான் இதுதான்! -

அழுதபடி அலிசா அப்துல்லா புகார்.. ஒரே நாளில் திருச்சி சூர்யாவை தூக்கிய போலீஸ்! தலைமறைவான முக்தார்?

அழுதபடி அலிசா அப்துல்லா புகார்.. ஒரே நாளில் திருச்சி சூர்யாவை தூக்கிய போலீஸ்! தலைமறைவான முக்தார்? -

பயங்கரமான ஆளுங்க விஜய்! காங்கிரஸுக்கு தான் சீட்டு.. ஆனா எம்பி எங்களுங்க! ராஜ்சபா சீட்டு யாருக்கு?

பயங்கரமான ஆளுங்க விஜய்! காங்கிரஸுக்கு தான் சீட்டு.. ஆனா எம்பி எங்களுங்க! ராஜ்சபா சீட்டு யாருக்கு? -

துன்பத்திலும் ஒரு இன்பம்.. மத்திய அமைச்சராகும் நயினார்! தமிழக பாஜக புதிய தலைவர் இவரா? கலகல கமலாலயம்!

துன்பத்திலும் ஒரு இன்பம்.. மத்திய அமைச்சராகும் நயினார்! தமிழக பாஜக புதிய தலைவர் இவரா? கலகல கமலாலயம்! -

ரூ.72 லட்சம் பணம் அக்கவுண்டில் ஏறியதும் ஊரைவிட்டே ‘எஸ்கேப்’.. மோசடி புகாரில் தவெக நிர்வாகி கைது!

ரூ.72 லட்சம் பணம் அக்கவுண்டில் ஏறியதும் ஊரைவிட்டே ‘எஸ்கேப்’.. மோசடி புகாரில் தவெக நிர்வாகி கைது! -

தவெக பெண் எம்எல்ஏவை அவமானப்படுத்திய சென்னை மேயர் பிரியா? குத்துவிளக்கேற்றுவதில் வெடித்த மோதல்!

தவெக பெண் எம்எல்ஏவை அவமானப்படுத்திய சென்னை மேயர் பிரியா? குத்துவிளக்கேற்றுவதில் வெடித்த மோதல்!

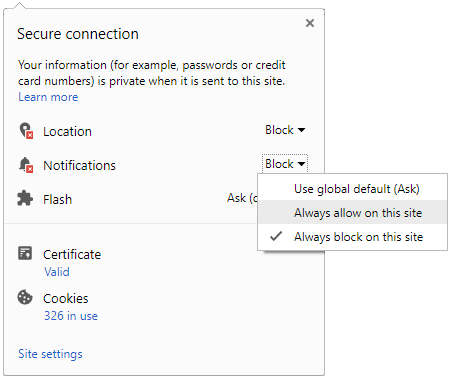

Click it and Unblock the Notifications

Click it and Unblock the Notifications